Além do Chatbot: A Ascensão dos Sistemas Multiagentes (MAS) e o Fim da “IA Solitária”

- #IA Agents

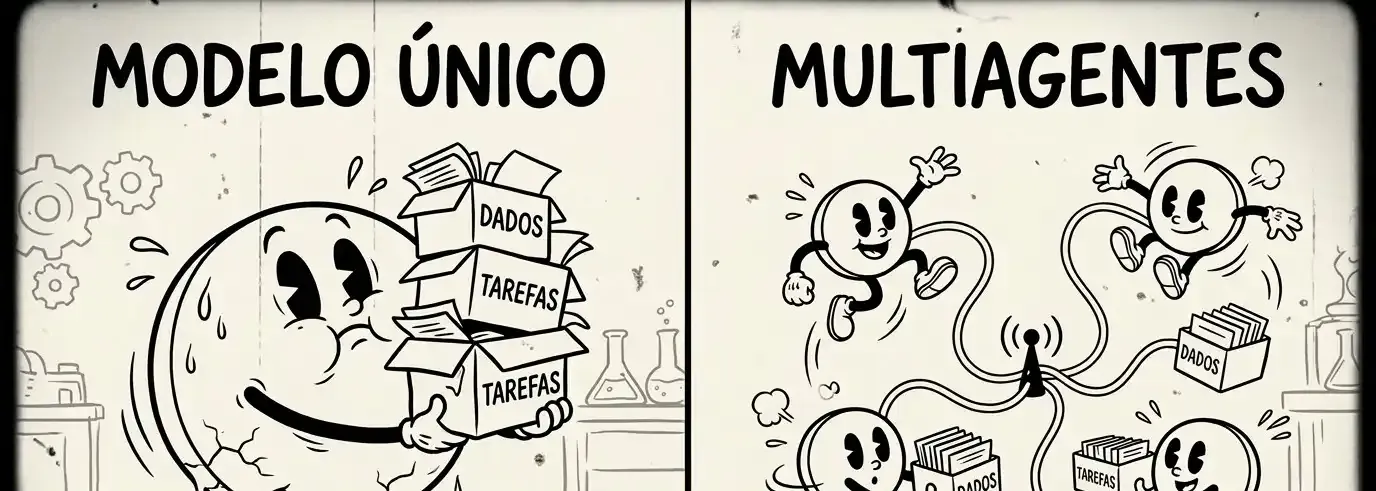

Durante os últimos anos, a forma predominante de interação com inteligência artificial foi relativamente simples. Uma caixa de texto, um prompt e a expectativa de que um único modelo fosse capaz de interpretar o problema, raciocinar sobre ele e entregar uma solução completa. Esse paradigma tornou os modelos de linguagem extremamente populares e acessíveis, mas também revelou uma limitação estrutural importante quando aplicado a problemas mais complexos. Utilizar um único sistema generalista para executar tarefas cognitivamente distintas é comparável a empregar um motor de altíssimo desempenho em uma tarefa que exige precisão, coordenação e especialização em múltiplas etapas. Funciona até certo ponto, mas não representa a forma mais eficiente de explorar o potencial real da tecnologia.

A partir de 2026, a discussão técnica sobre inteligência artificial aplicada à engenharia de software começou a mudar significativamente. Em vez de depender de um único modelo monolítico tentando assumir simultaneamente papéis de analista, arquiteto, desenvolvedor e auditor de qualidade, as arquiteturas modernas passaram a adotar uma abordagem inspirada em sistemas distribuídos. Surge então o conceito de Sistemas Multiagentes, ou MAS, no qual diferentes agentes de inteligência artificial colaboram entre si para resolver problemas complexos por meio de especialização funcional. Nesse contexto, o diferencial competitivo deixa de ser apenas o tamanho ou a capacidade de um modelo isolado e passa a ser a qualidade da orquestração entre múltiplos agentes especializados. A pergunta relevante deixa de ser qual é o maior modelo disponível e passa a ser como organizar agentes autônomos para cooperarem de forma eficiente dentro de um fluxo cognitivo estruturado.

O problema da IA generalista

Modelos de linguagem de grande escala possuem uma capacidade impressionante de generalização semântica, mas essa mesma característica pode se tornar um obstáculo quando o sistema é solicitado a executar tarefas de natureza muito diferente dentro de um único ciclo de raciocínio. Quando um único modelo recebe a responsabilidade de interpretar requisitos de negócio, projetar uma arquitetura técnica, escrever código, criar testes e revisar vulnerabilidades de segurança, ele precisa manter simultaneamente diversos níveis de abstração dentro de uma única janela de contexto. Essa sobrecarga cognitiva frequentemente resulta em inconsistências internas, perda de coerência arquitetural ou na geração de soluções tecnicamente plausíveis, mas estruturalmente frágeis.

A resposta encontrada por muitas equipes de engenharia que trabalham na fronteira da automação baseada em IA foi aplicar um princípio clássico da engenharia de software: a separação de responsabilidades. Em vez de delegar todo o processo a um único agente, cria-se um conjunto de agentes especializados, cada um com um escopo de atuação claramente delimitado. Esses agentes interagem entre si dentro de um fluxo estruturado de comunicação, trocando informações, validando resultados intermediários e refinando soluções antes que o resultado final seja apresentado ao usuário.

Essa abordagem transforma um simples sistema de geração de texto em algo muito mais próximo de uma equipe digital organizada. Cada agente assume um papel funcional específico e contribui para o resultado final de maneira semelhante ao que acontece em um time humano de engenharia.

A formação de uma equipe digital

Em uma arquitetura baseada em MAS, agentes são frequentemente modelados como personas operacionais. Cada um possui um objetivo específico, um conjunto restrito de ferramentas disponíveis e um contexto especializado que orienta sua tomada de decisão. Em vez de executar um único script linear, o sistema passa a operar como uma cadeia de colaboração entre diferentes unidades cognitivas artificiais.

Um exemplo bastante comum envolve três papéis fundamentais. O primeiro agente atua como analista de requisitos. Sua responsabilidade consiste em interpretar a solicitação inicial do usuário e transformá-la em uma especificação técnica mais estruturada. Ele identifica ambiguidades, divide o problema em subtarefas e estabelece critérios mínimos de aceitação. Em vez de produzir código, esse agente produz clareza estrutural.

A partir dessa especificação, entra em ação o agente desenvolvedor. Esse agente recebe a tarefa já decomposta e executa a implementação propriamente dita. Em ambientes mais avançados, ele pode possuir acesso controlado a ferramentas externas, como sistemas de escrita de arquivos, execução de linters, compiladores ou ambientes de teste automatizado. A presença dessas ferramentas reduz significativamente a aleatoriedade típica da geração de código puramente textual, aproximando o comportamento do agente de um ambiente real de desenvolvimento.

Após a etapa de implementação, um terceiro agente assume o papel de revisor de qualidade e segurança. Esse agente analisa o resultado produzido pelo desenvolvedor e procura identificar falhas estruturais, vulnerabilidades ou violações de boas práticas. Diferentemente de um simples verificador sintático, ele opera com um foco deliberadamente crítico. Seu objetivo é encontrar problemas antes que o resultado seja considerado final.

O aspecto mais interessante desse tipo de arquitetura é que os agentes não precisam interagir diretamente com o usuário durante todo o processo. Quando o revisor encontra um problema, ele pode devolver o artefato para o agente desenvolvedor juntamente com um relatório estruturado de inconsistências. O sistema entra então em um ciclo de refinamento interno até que determinados critérios de qualidade sejam atingidos. Esse mecanismo cria um tipo de revisão automatizada que ocorre antes mesmo de qualquer intervenção humana.

Frameworks para orquestração de agentes

Com o crescimento do interesse por sistemas multiagentes, surgiram ferramentas dedicadas à criação e coordenação desses fluxos de trabalho. Entre os frameworks mais relevantes atualmente encontram-se o CrewAI e o LangGraph, cada um com uma filosofia arquitetural distinta.

O CrewAI foi projetado para simplificar a construção de equipes de agentes orientadas por papéis. Nele, cada agente recebe uma identidade funcional acompanhada de uma descrição detalhada de sua experiência, conhecimento e responsabilidades. Esse contexto narrativo ajuda o modelo a manter consistência comportamental durante a execução das tarefas. O sistema organiza esses agentes em uma sequência de atividades que se assemelha a um fluxo tradicional de gestão de projetos. Essa abordagem torna o CrewAI particularmente eficaz para automações empresariais, geração de relatórios, análise de dados e fluxos de trabalho sequenciais que exigem coordenação simples entre diferentes papéis.

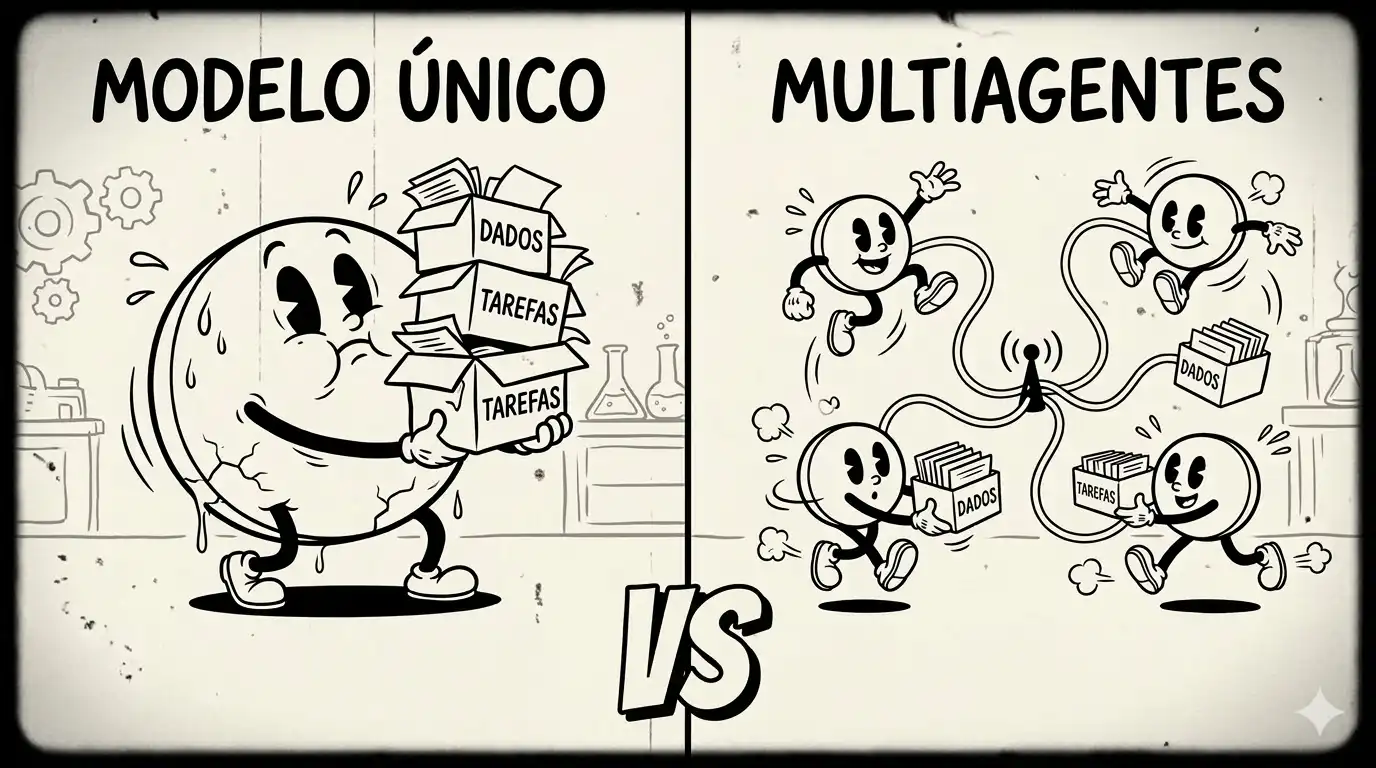

Já o LangGraph adota uma abordagem mais estrutural e técnica. Inspirado em conceitos de grafos direcionados, ele permite modelar sistemas de agentes como redes de nós e transições de estado. Cada nó representa uma etapa cognitiva ou um agente específico, enquanto as conexões entre nós determinam como o fluxo de informação progride ao longo do sistema. O grande diferencial dessa arquitetura está no tratamento explícito de estado persistente. Diferentemente de muitos pipelines tradicionais de IA, que executam tarefas de maneira efêmera, o LangGraph permite que um processo seja interrompido, armazenado e retomado posteriormente sem perda de contexto. Esse comportamento torna o framework particularmente adequado para aplicações corporativas de larga escala, nas quais fluxos de trabalho podem durar horas ou até dias e exigem rastreabilidade completa de decisões.

O papel do human-in-the-loop

Apesar do aumento significativo no grau de autonomia desses sistemas, arquiteturas maduras raramente delegam autoridade total a agentes artificiais. Em ambientes críticos, ainda é essencial manter um mecanismo de supervisão humana conhecido como human-in-the-loop. Nesse modelo, determinadas etapas do fluxo são explicitamente projetadas para exigir validação humana antes da execução final.

Frameworks como o LangGraph permitem inserir pontos de pausa programáticos dentro do fluxo de execução. O sistema pode analisar grandes quantidades de informação, preparar um plano de ação ou gerar alterações em múltiplos arquivos, mas interrompe sua própria execução antes de realizar ações potencialmente sensíveis. Nesse momento, um operador humano recebe o resultado intermediário e decide se a operação deve continuar.

Esse mecanismo não representa uma limitação da tecnologia, mas sim um elemento fundamental de governança. Em vez de eliminar o papel humano, a arquitetura multiagente redefine essa participação. A inteligência artificial passa a atuar como um executor extremamente eficiente de tarefas analíticas e operacionais, enquanto o humano permanece responsável por decisões estratégicas e validação final.

O programador como orquestrador

A evolução das arquiteturas de IA está provocando uma mudança sutil, porém profunda, no papel do desenvolvedor de software. Durante décadas, o foco da profissão esteve concentrado na escrita manual de código e na implementação detalhada de lógica de aplicação. À medida que modelos de linguagem e agentes autônomos assumem parte significativa desse trabalho operacional, o valor profissional desloca-se progressivamente para a capacidade de projetar sistemas que coordenem essas inteligências artificiais.

O desenvolvedor passa a atuar menos como um produtor direto de cada linha de código e mais como um arquiteto de fluxos cognitivos. Seu trabalho consiste em definir como agentes interagem, quais ferramentas possuem acesso, quais critérios determinam sucesso ou falha e em quais pontos o sistema deve solicitar intervenção humana. Em vez de simplesmente escrever software, ele passa a desenhar ecossistemas de colaboração entre humanos e máquinas.

Essa transição lembra a evolução que ocorreu na engenharia de software com a adoção de sistemas distribuídos. Em um determinado momento, deixou de ser suficiente escrever código eficiente em uma única máquina. Tornou-se necessário compreender como múltiplos serviços independentes poderiam cooperar em larga escala. Com sistemas multiagentes, estamos testemunhando um movimento conceitualmente semelhante, mas aplicado à inteligência artificial.

O resultado final é uma nova categoria de habilidade técnica: a capacidade de orquestrar inteligência. Em um cenário no qual agentes especializados podem analisar requisitos, gerar código, revisar vulnerabilidades e preparar implantações, o diferencial humano passa a ser a capacidade de estruturar esses processos de maneira confiável, transparente e governável.

Nesse novo paradigma, o verdadeiro salto de produtividade não ocorre apenas quando um modelo escreve código rapidamente. Ele ocorre quando vários agentes colaboram, revisam e refinam soluções entre si antes mesmo que o resultado chegue ao usuário. Nesse momento, a inteligência artificial deixa de ser apenas uma ferramenta reativa e passa a se comportar como uma equipe digital coordenada.

A tecnologia necessária para isso já existe. O desafio agora não é mais acessar modelos poderosos, mas aprender a projetar sistemas capazes de delegar tarefas cognitivas de forma inteligente. A questão que surge para desenvolvedores e organizações é simples e inevitável. Continuaremos interagindo com a IA como usuários individuais ou começaremos a coordenar verdadeiras equipes digitais trabalhando em nosso nome.

Documentação e Frameworks

- LangChain / LangGraph Documentation: "Multi-agent Systems and State Management in Graphs".

- CrewAI Official Docs: "Role-Based Agent Design and Process Orchestration".

- Microsoft AutoGen: "Automating Next-Generation LLM Applications".

Artigos e Papers de Referência

- Wu, Q., et al. (2023): "AutoGen: Enabling Next-Gen LLM Applications via Multi-Agent Conversation Framework." .

- Park, J. S., et al. (2023): "Generative Agents: Interactive Simulacra of Human Behavior.".

- Anthropic Research: "Core Views on AI Safety and Governance".