Do Caos à Clareza: Descomplicando a Engenharia de Prompt

- #Aprendizagem Contínua

- #Otimização Estratégica de Fluxos de Trabalho

- #IA Generativa

- #Inteligência Artificial (IA)

- #Engenharia de Prompt

- #LLMs

Se você é daquelas pessoas que entendeu que a IA pode potencializar sua produtividade e a usa no seu dia a dia seja como um assistente pessoal ou ferramenta de trabalho, e se você busca estudar o assunto, com certeza já se deparou com o termo "engenharia de prompt". Confesso que, em um primeiro momento, quando me deparei com esse termo eu tive um pouco de aversão, mesmo sem conhecê-lo. Talvez a palavra "engenharia" seja a responsável por isso, pois é possível imaginar algo complexo, cheio de cálculos e fórmulas...

Mas a realidade é muito mais amigável. A "engenharia de prompt" não exige que você saiba programar ou resolver equações diferenciais. Na verdade, ela trata de algo que fazemos todos os dias: comunicação.

Pense na Inteligência Artificial, como o ChatGPT, Claude ou Gemini, como um estagiário incrivelmente brilhante, que leu todos os livros da biblioteca, mas que não tem nenhum contexto sobre quem você é ou o que você precisa especificamente. Se você der uma instrução vaga, receberá uma resposta vaga. Se você for preciso, estruturado e claro, receberá ouro.

A engenharia de prompt é a ciência (e a arte) de desenhar essas instruções para obter o melhor resultado possível. E para te provar que isso não é apenas "achismo", vamos nos fundamentar no que a ciência da computação mais avançada diz sobre o assunto.

O Que Diz a Ciência: Modelos de Linguagem são Aprendizes de Poucos Disparos

Para entender como falar com a IA, precisamos entender como ela "pensa". Os Grandes Modelos de Linguagem (LLMs) são treinados com volumes massivos de dados para prever a próxima palavra em uma sequência. Mas eles têm uma capacidade incrível chamada "In-Context Learning" (Aprendizado em Contexto).

Um artigo seminal da OpenAI, "Language Models are Few-Shot Learners" (Brown et al., 2020), demonstrou que fornecer exemplos dentro do seu prompt ("few-shot") faz com que o modelo aprenda a tarefa instantaneamente, sem precisar de re-treinamento. Se você der apenas a instrução ("zero-shot"), ele tenta adivinhar. Se você der três exemplos de como quer a resposta, ele replicará o padrão com precisão cirúrgica.

Aprendizado Prático nº 1:

Nunca peça apenas "Faça X". Prefira: "Faça X seguindo este formato. Exemplo 1: Entrada -> Saída. Exemplo 2: Entrada -> Saída. Agora faça com esta Entrada:"

A Técnica de Ouro: Peça para a IA "Pensar"

A maior revolução prática na engenharia de prompt veio com a técnica chamada "Chain-of-Thought" (CoT), ou Cadeia de Raciocínio. No artigo "Chain-of-Thought Prompting Elicits Reasoning in Large Language Models" (Wei et al., 2022), pesquisadores do Google mostraram que, para tarefas complexas de lógica ou matemática, se você pedir para o modelo explicitar o seu raciocínio passo a passo antes de dar a resposta final, a taxa de acerto sobe drasticamente.

Por que isso funciona? Porque ao forçar o modelo a gerar os passos intermediários, ele quebra o problema em pedaços menores e reduz a chance de "alucinar" (inventar informações) no caminho para a conclusão.

Aprendizado Prático nº 2:

Ao lidar com problemas difíceis ou análises profundas, adicione esta frase simples ao seu prompt: "Analise a situação passo a passo e, antes de me dar a conclusão final, explique seu raciocínio para cada etapa."

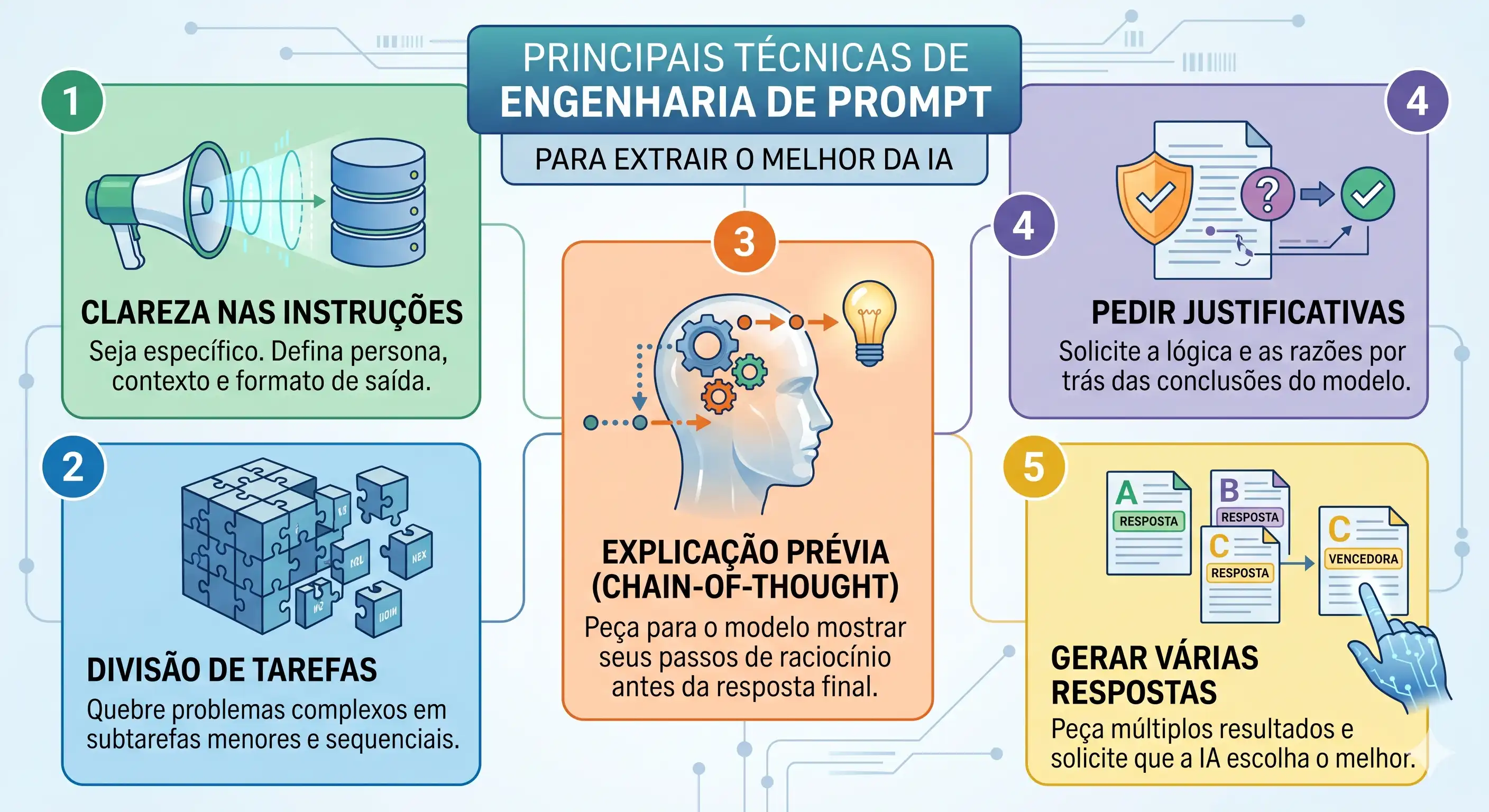

5 Técnicas Fundamentais

Para facilitar o seu aprendizado, criamos um infográfico que resume as técnicas mais eficazes de engenharia de prompt, muitas delas baseadas nos princípios científicos que discutimos.

Como aplicar estas técnicas no seu dia a dia (Baseado na Imagem):

- Ter clareza ao dar as instruções: Trate o prompt como um contrato. Defina quem a IA deve ser (Persona: "Aja como um especialista em marketing"), qual o Contexto ("Estamos lançando um café orgânico"), e qual o Formato de Saída ("Crie uma tabela com 5 ideias de posts").

- Dividir tarefas complexas em subtarefas menores: Em vez de pedir "Escreva um e-book sobre IA", quebre o pedido: Primeiro peça a estrutura dos capítulos. Em seguida, peça para escrever o Capítulo 1. Depois o 2, e assim por diante. Isso mantém a qualidade e o foco do modelo.

- Pedir para o modelo explicar seus passos antes de dar a resposta: Como vimos em Wei et al. (2022), essa é a técnica Chain-of-Thought. Ela é essencial para garantir que a lógica da IA está correta antes que você confie no resultado.

- Pedir para o modelo dar justificativas de suas respostas: Se você não concorda com algo, pergunte "Por que você sugere isso? Baseie sua resposta em dados do texto/contexto fornecido." Isso ajuda a validar as informações.

- Gerar várias respostas diferentes e pedir para o modelo escolher a melhor: Se você precisa de criatividade, peça: "Gere 5 opções de títulos diferentes para este artigo." Em seguida, dê um comando adicional: "Desses 5, analise qual é o mais chamativo e clique-bait, e justifique sua escolha." Você está usando a IA como criadora e como editora.

Dominar a engenharia de prompt não é sobre aprender códigos secretos, mas sobre se tornar um comunicador melhor e um gestor mais eficiente da inteligência que está à sua disposição. Ao aplicar a clareza, a estrutura (divisão de tarefas) e a exigência de raciocínio (explicação prévia e justificativa), você não está apenas "usando" a IA, você está colaborando com ela para atingir resultados que seriam impossíveis de alcançar sozinho. Experimente estas técnicas hoje e veja sua produtividade dar um salto real :)

Referências:

BROWN, Tom B. et al. Language Models are Few-Shot Learners. OpenAI, 2020.

WEI, Jason et al. Chain-of-Thought Prompting Elicits Reasoning in Large Language Models. Google Research, 2022.