Entropia de Senhas: A Física por Trás da Segurança Digital

Como um conceito da termodinâmica protege — ou falha em proteger — suas credenciais online

Você já parou para pensar por que sistemas exigem que suas senhas tenham letras maiúsculas, números e símbolos especiais? A resposta não está apenas em burocracia corporativa — ela tem raízes profundas na física, na matemática e na teoria da informação. O conceito por trás de tudo isso chama-se entropia, e entender como ela funciona pode transformar radicalmente a forma como você cria e avalia suas senhas.

⚛️ Entropia na Física: O Caos como Medida

Na termodinâmica, a entropia é uma grandeza que mede o grau de desordem ou aleatoriedade de um sistema. Foi formalizada por Rudolf Clausius no século XIX e depois expandida por Ludwig Boltzmann em sua famosa equação estatística. Quanto maior a entropia de um sistema, maior é o número de estados microscópicos que ele pode assumir.

Analogia física: Imagine uma caixa dividida ao meio — do lado esquerdo, moléculas de gás quente; do lado direito, gás frio. Ao retirar a divisória, as moléculas se misturam caoticamente. Esse estado misturado possui entropia muito maior — e jamais voltará espontaneamente ao estado organizado. A natureza favorece a desordem.

A equação de Boltzmann para a entropia termodinâmica é:

S = k · ln(W)

Onde:

S → Entropia do sistema (J/K)

k → Constante de Boltzmann ≈ 1,38 × 10⁻²³ J/K

W → Número de microestados possíveis

ln → Logaritmo natural

O ponto central é simples: mais microestados possíveis = maior entropia = maior imprevisibilidade. Essa lógica migrou para a teoria da informação com elegância matemática.

📡 Claude Shannon e a Teoria da Informação

Em 1948, o matemático Claude Shannon publicou "A Mathematical Theory of Communication", um dos textos mais influentes do século XX. Shannon precisava quantificar a incerteza presente em mensagens transmitidas por canais de comunicação e percebeu que o conceito de entropia da física era perfeito para isso.

💡 Insight de Shannon: A entropia de uma fonte de informação mede a incerteza média sobre qual símbolo será transmitido. Quanto mais imprevisível a sequência, maior a entropia — e mais informação ela carrega por símbolo.

A fórmula da Entropia de Shannon para uma variável aleatória discreta é:

H(X) = −Σ P(xᵢ) · log₂ P(xᵢ)

Onde:

H(X) → Entropia em bits

P(xᵢ) → Probabilidade do símbolo i ocorrer

log₂ → Logaritmo na base 2

Σ → Somatório sobre todos os símbolos

Para senhas, podemos derivar uma fórmula mais direta. Se cada caractere é escolhido uniformemente de um alfabeto de tamanho R, e a senha tem L caracteres:

E = L · log₂(R)

Onde:

E → Entropia da senha em bits

L → Comprimento da senha

R → Tamanho do conjunto de caracteres

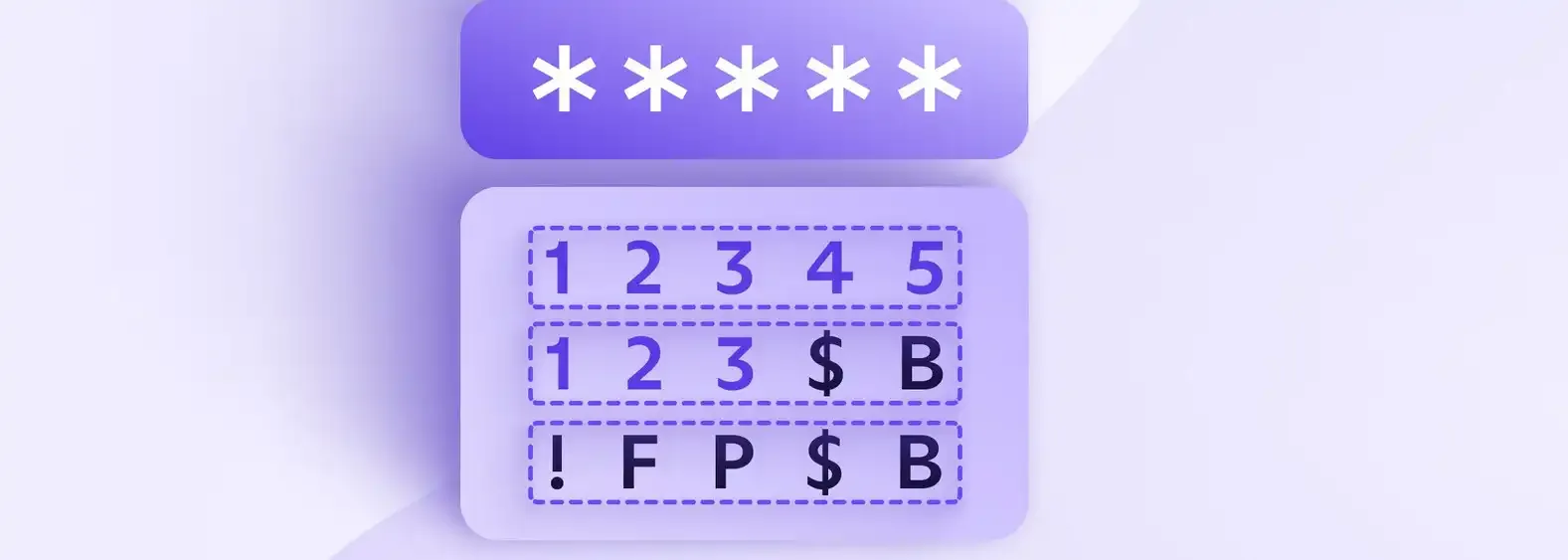

🔐 Aplicando Entropia a Senhas

Escala de força por bits de entropia

Bits de Entropia Nível de Segurança< 28 bits 🔴 Muito fraco — quebrável em segundos 28–35 bits 🟠 Fraco — proteção mínima 36–59 bits🟡 Razoável — adequado para uso geral 60–127 bits🟢 Forte — adequado para dados sensíveis 128+ bits✅ Muito forte — padrão criptográfico

🧮 O Cálculo: Senha Fraca vs. Senha Forte

Vamos realizar um cálculo completo e comparar duas senhas: uma fraca, comum no dia a dia, e uma construída com os princípios de entropia. Assumiremos um ataque brute force com uma máquina moderna capaz de testar 10 bilhões de tentativas por segundo (10¹⁰/s) — velocidade realista para ataques offline com GPUs dedicadas (ex.: Hashcat + RTX 4090).

Senha em análise

Propriedade ❌ Senha Fraca ✅ Senha Forte Senhasenha123K#9mPx!2vQ@zL$7nComprimento (L) 8 caracteres 16 caracteres Conjunto usado minúsc. + dígitos todos os imprimíveis Tamanho do conjunto R = 36R = 95

Passo 1 — Calcular a Entropia (E = L × log₂(R))

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

SENHA FRACA: "senha123"

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

L = 8 caracteres

R = 36 (26 minúsc. + 10 dígitos)

E = 8 × log₂(36)

E = 8 × 5,17

E ≈ 41,37 bits (teórico)

⚠️ NOTA: "senha123" é uma palavra do dicionário

com sequência previsível. Na prática, a entropia

REAL é menor que 10 bits.

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

SENHA FORTE: "K#9mPx!2vQ@zL$7n"

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

L = 16 caracteres

R = 95 (26 minúsc. + 26 maiúsc. + 10 dígitos + 33 especiais)

E = 16 × log₂(95)

E = 16 × 6,57

E ≈ 105,10 bits

Passo 2 — Calcular o Espaço de Busca (C = Rᴸ)

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

SENHA FRACA "senha123":

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

C = 36⁸

C ≈ 2,82 × 10¹² combinações

C = 2.821.109.907.456

(Ignorando aqui que é palavra do dicionário)

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

SENHA FORTE "K#9mPx!2vQ@zL$7n":

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

C = 95¹⁶

C ≈ 1,34 × 10³¹ combinações

Diferença: a senha forte tem

10 quintilhões de vezes mais combinações.

Passo 3 — Calcular o Tempo de Brute Force

Taxa do atacante: 10.000.000.000 tentativas/s (10¹⁰/s)

GPU moderna em ataque offline (Hashcat + RTX 4090)

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

SENHA FRACA — "senha123"

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

T (pior caso) = C / taxa

T = 2,82 × 10¹² / 10¹⁰

T = 282 segundos

T ≈ ~4,7 minutos (pior caso)

T ≈ ~2,3 minutos (média — 50% do espaço)

Na prática, como é palavra do dicionário:

→ Quebrada em MILISSEGUNDOS com ataque de dicionário!

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

SENHA FORTE — "K#9mPx!2vQ@zL$7n"

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

T = 1,34 × 10³¹ / 10¹⁰

T = 1,34 × 10²¹ segundos

Convertendo:

÷ 60 → 2,23 × 10¹⁹ minutos

÷ 60 → 3,72 × 10¹⁷ horas

÷ 24 → 1,55 × 10¹⁶ dias

÷ 365,25 → 4,25 × 10¹³ anos

≈ 42 TRILHÕES DE ANOS

O universo tem ~13,8 bilhões de anos.

A senha forte aguentaria ~3.000× a idade do universo.

⚠️ Atenção: Entropia Teórica vs. Real

A fórmulaE = L × log₂(R)assume que cada caractere é escolhido uniformemente ao acaso. Senhas baseadas em palavras do dicionário, datas, nomes ou padrões previsíveis têm entropia real muito menor que a calculada."senha123"pode ter entropia teórica de 41 bits, mas um atacante com lista de senhas comuns encontra-a em milissegundos.

🎲 A Analogia do Dado: Física e Segurança

Pense em um dado de 6 faces. Lançado uma vez, ele pode assumir 6 estados. A entropia desse sistema é log₂(6) ≈ 2,58 bits. Agora imagine que você lança esse dado 16 vezes e anota cada resultado — o número de combinações possíveis é 6¹⁶ ≈ 2,8 × 10¹².

Uma senha é exatamente isso: cada posição é um "dado" com R faces. Quanto mais faces (R maior), e quanto mais vezes você o lança (L maior), mais imprevisível — e segura — é a sequência resultante. A entropia é simplesmente a medida dessa imprevisibilidade.

Esse é o motivo pelo qual adicionar um único tipo de caractere ao conjunto aumenta a segurança exponencialmente: você não está somando faces ao dado — está multiplicando o número de combinações.

Senha de 12 caracteres — variando o conjunto (R):

Taxa do atacante: 10¹⁰/s | Tempo = pior caso

R = 26 (só minúsc.) 26¹² ≈ 9,5 × 10¹⁶ → ~109 dias

R = 52 (+maiúsc.) 52¹² ≈ 3,9 × 10²⁰ → ~1.200 anos

R = 62 (+dígitos) 62¹² ≈ 3,2 × 10²¹ → ~10.000 anos

R = 95 (+especiais) 95¹² ≈ 5,4 × 10²³ → ~1,7 bilhões de anos

🛡️ Aplicabilidade: Onde a Entropia Importa

1. Sistemas de autenticação e política de senhas

Qualquer sistema que defina regras de senha (comprimento mínimo, uso de maiúsculas, números e símbolos) está, essencialmente, forçando o aumento do conjunto R e do comprimento L — garantindo uma entropia mínima. Sistemas modernos calculam a entropia durante o cadastro e exibem um medidor de força baseado nela.

2. Geradores de senhas

Ferramentas como Bitwarden, 1 Password e KeePass utilizam geradores criptograficamente seguros (CSPRNG) para produzir senhas com entropia máxima. Eles garantem que cada caractere seja escolhido com distribuição uniforme, alcançando a entropia teórica da fórmula.

3. Hashing e armazenamento seguro

Mesmo com alta entropia, senhas armazenadas sem proteção adequada são vulneráveis. Funções como bcrypt, scrypt e Argon2 foram projetadas para ser computacionalmente custosas, tornando ataques brute force ordens de magnitude mais lentos — independentemente da entropia da senha.

4. Chaves criptográficas

Na criptografia simétrica, chaves de 128 bits (AES-128) têm entropia de 128 bits — equivalente a uma senha aleatória de ~20 caracteres de um alfabeto de 95. Chaves de 256 bits (AES-256) oferecem segurança considerada inquebrável para qualquer computador clássico.

5. Método Diceware: senhas longas e memoráveis

O matemático Arnold Reinhold propôs o Diceware: escolher palavras aleatórias de um dicionário de 7.776 palavras usando dados físicos. Uma frase de 5 palavras tem entropia ≈ log₂(7776⁵) ≈ 64 bits — forte e muito mais memorável que K#9mPx!2vQ@zL$7n.

✅ Exemplo Diceware: "cavalo bateria prego correto" — 4 palavras aleatórias formam uma senha de ~51 bits de entropia, possível de memorizar e difícil de quebrar. (Inspirado no famoso quadrinho xkcd #936)📌 Resumo

A entropia de senhas é um conceito elegante que une a física do século XIX à segurança digital do século XXI. Compreendê-la não é apenas um exercício acadêmico — é uma ferramenta prática que nos permite avaliar objetivamente a força de nossas credenciais e tomar decisões mais inteligentes sobre como nos proteger online.

Na próxima vez que um sistema recusar sua senha por ser "muito simples", lembre-se: ele está, a seu modo, aplicando a segunda lei da termodinâmica à sua segurança digital. O caos — a imprevisibilidade — está do seu lado.